Pendahuluan

Perkembangan kecerdasan buatan dalam beberapa tahun terakhir mengalami akselerasi yang sangat cepat. Kehadiran Large Language Model (LLM) seperti yang digunakan oleh OpenAI, DeepMind, maupun perusahaan teknologi besar lainnya telah mengubah cara manusia berinteraksi dengan mesin. Sistem AI modern kini mampu menulis, menerjemahkan, membuat kode program, menganalisis data, hingga melakukan simulasi percakapan dengan tingkat kompleksitas yang sebelumnya sulit dibayangkan.

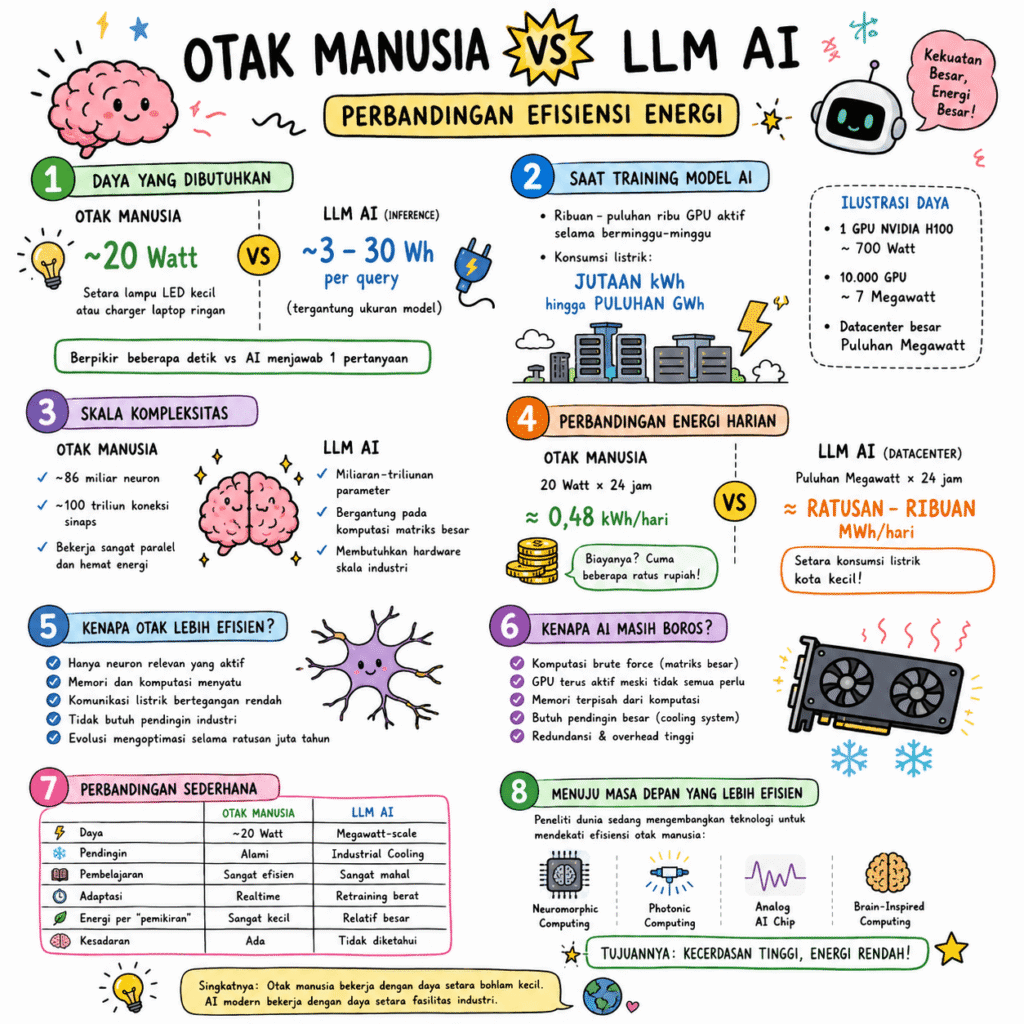

Namun di balik kemampuan tersebut terdapat satu aspek yang mulai menjadi perhatian serius kalangan akademisi, industri teknologi, dan pemerhati energi global, yaitu kebutuhan daya listrik yang sangat besar. Pertanyaan mendasarnya menjadi menarik: mengapa otak manusia yang hanya membutuhkan sekitar 20 watt mampu melakukan fungsi kognitif yang sangat kompleks, sementara sistem AI modern membutuhkan ribuan GPU dan konsumsi energi setara kawasan industri?

Kajian ini membahas perbandingan efisiensi energi antara otak manusia dan sistem Large Language Model modern dari sudut pandang biologis, komputasional, serta implikasi ekologis dan teknologi di masa depan.

Otak Manusia sebagai Sistem Komputasi Biologis

Otak manusia merupakan organ biologis dengan kompleksitas luar biasa. Beratnya hanya sekitar 1,3–1,4 kilogram atau kurang dari 2% massa tubuh manusia, tetapi mengonsumsi sekitar 20% total energi tubuh.

Secara rata-rata, otak manusia hanya membutuhkan daya sekitar:

20 watt20 \text{ watt}

atau setara dengan lampu LED rumah tangga berdaya kecil.

Di dalam otak terdapat sekitar:

- 86 miliar neuron

- lebih dari 100 triliun koneksi sinapsis

Setiap neuron mampu mengirimkan sinyal elektrokimia secara simultan dalam jaringan paralel yang sangat kompleks. Yang menarik, seluruh proses tersebut berlangsung dengan efisiensi energi yang sangat tinggi.

Tidak seperti komputer modern yang memisahkan antara memori dan prosesor, otak manusia menyimpan dan memproses informasi pada struktur yang relatif menyatu. Hal ini mengurangi kebutuhan perpindahan data yang dalam sistem komputer modern justru menjadi salah satu sumber konsumsi energi terbesar.

Selain itu, otak tidak pernah benar-benar “menyalakan seluruh sistem” secara bersamaan. Aktivasi neuron berlangsung selektif dan kontekstual. Hanya bagian tertentu yang aktif sesuai kebutuhan kognitif saat itu. Mekanisme inilah yang membuat otak sangat hemat energi.

Large Language Model dan Infrastruktur Komputasi Modern

Berbeda dengan sistem biologis, Large Language Model dibangun di atas arsitektur komputasi digital berbasis transistor. LLM modern dilatih menggunakan miliaran hingga triliunan parameter melalui proses yang disebut training.

Dalam proses training, model harus:

- membaca dataset dalam jumlah sangat besar,

- menghitung hubungan statistik antar-token,

- melakukan optimasi parameter secara iteratif,

- dan menjalankan komputasi matriks dalam skala ekstrem.

Proses ini dijalankan menggunakan GPU kelas datacenter seperti:

- NVIDIA H100

- TPU milik Google

- akselerator AI milik AMD dan perusahaan lain.

Satu GPU modern saja dapat mengonsumsi daya:

500−700 watt500-700 \text{ watt}

Dalam training model skala besar, ribuan hingga puluhan ribu GPU dijalankan secara paralel selama berminggu-minggu bahkan berbulan-bulan.

Sebagai ilustrasi sederhana:

| Komponen | Estimasi Konsumsi Daya |

|---|---|

| Otak manusia | ±20 watt |

| 1 GPU AI modern | ±700 watt |

| 10.000 GPU | ±7 megawatt |

| Datacenter AI besar | puluhan megawatt |

Konsumsi tersebut belum termasuk:

- sistem pendingin,

- jaringan data,

- penyimpanan,

- UPS,

- dan infrastruktur kelistrikan pendukung.

Dengan kata lain, sebagian besar energi pada AI modern tidak hanya digunakan untuk “berpikir,” tetapi juga untuk menjaga sistem tetap stabil dan tidak mengalami overheating.

Efisiensi Energi: Biologi vs Silicon

Perbedaan paling fundamental antara otak manusia dan AI modern terletak pada cara keduanya memproses informasi.

1. Sistem Paralel Biologis

Otak bekerja secara massively parallel dalam jaringan biologis yang sangat efisien. Neuron hanya aktif ketika diperlukan, dan komunikasi berlangsung menggunakan impuls elektrokimia bertegangan rendah.

Energi digunakan secara adaptif dan kontekstual.

Sebaliknya, GPU modern menjalankan operasi matematis dalam jumlah sangat besar secara simultan, meskipun sebagian operasi sebenarnya redundan terhadap konteks.

2. Memori dan Komputasi

Dalam komputer modern terdapat pemisahan antara:

- prosesor,

- RAM,

- storage.

Perpindahan data antar-komponen memerlukan energi signifikan.

Pada otak manusia, memori dan komputasi lebih terintegrasi melalui jaringan sinapsis. Hal ini membuat biaya energi untuk transfer informasi jauh lebih rendah.

3. Pendinginan

Otak manusia menggunakan sistem pendinginan biologis alami melalui:

- aliran darah,

- regulasi suhu tubuh,

- metabolisme.

Sementara itu, datacenter AI membutuhkan:

- industrial cooling,

- liquid cooling,

- HVAC skala besar,

- bahkan sistem pendingin berbasis cairan khusus.

Pada beberapa datacenter AI modern, energi untuk pendinginan dapat menjadi proporsi signifikan dari total konsumsi listrik.

Konsumsi Energi pada Proses Inference

Selain training, konsumsi energi juga terjadi saat AI digunakan sehari-hari atau disebut inference.

Ketika pengguna mengirim pertanyaan ke model AI:

- GPU aktif,

- model dimuat ke memori,

- token diproses,

- hasil dihitung secara probabilistik.

Estimasi energi per query memang jauh lebih kecil dibanding training, tetapi tetap lebih besar dibanding proses berpikir biologis manusia.

Sebagai gambaran umum:

| Aktivitas | Estimasi Energi |

|---|---|

| Berpikir manusia beberapa detik | sangat kecil |

| Pencarian mesin pencari | rendah |

| Query LLM besar | relatif lebih tinggi |

Karena penggunaan AI terus meningkat secara global, akumulasi konsumsi energi inference menjadi isu yang semakin penting.

Dampak terhadap Infrastruktur Energi Global

Perkembangan AI saat ini mulai memengaruhi strategi energi global. Banyak negara dan perusahaan teknologi kini mempertimbangkan:

- pembangunan pembangkit listrik baru,

- penggunaan energi terbarukan,

- efisiensi datacenter,

- dan optimasi perangkat keras AI.

Perusahaan seperti:

- Microsoft

- Amazon

- Meta Platforms

mulai berinvestasi besar pada energi hijau dan efisiensi komputasi karena pertumbuhan kebutuhan AI diproyeksikan terus meningkat dalam dekade mendatang.

Dalam beberapa laporan industri, AI bahkan diperkirakan akan menjadi salah satu pendorong utama kenaikan konsumsi listrik datacenter global.

Upaya Meniru Efisiensi Otak Manusia

Keterbatasan efisiensi energi AI mendorong munculnya berbagai pendekatan baru, antara lain:

Neuromorphic Computing

Pendekatan ini mencoba meniru cara kerja neuron biologis.

Contohnya:

- chip Loihi milik Intel

- TrueNorth milik IBM

Tujuannya adalah menciptakan sistem AI dengan konsumsi energi jauh lebih rendah.

Photonic Computing

Komputasi menggunakan cahaya (photon) dibanding elektron mulai dikembangkan untuk mengurangi panas dan konsumsi daya.

Analog AI

Berbeda dengan sistem digital murni, pendekatan analog mencoba melakukan komputasi dengan mekanisme yang lebih menyerupai sistem biologis.

Dimensi Filosofis dan Kognitif

Meskipun AI modern mampu menghasilkan teks dan respons yang tampak cerdas, terdapat perbedaan fundamental dengan otak manusia.

Otak manusia memiliki:

- kesadaran,

- emosi,

- intuisi,

- pengalaman subjektif,

- dan kemampuan adaptasi biologis.

LLM modern pada dasarnya bekerja melalui prediksi probabilistik berdasarkan pola data.

Dengan kata lain, AI modern belum “memahami” dalam arti biologis dan fenomenologis sebagaimana manusia memahami.

Hal ini menunjukkan bahwa kecerdasan biologis bukan sekadar persoalan kapasitas komputasi, tetapi juga hasil evolusi biologis yang sangat panjang dan kompleks.

Kesimpulan

Otak manusia hingga saat ini masih menjadi sistem komputasi paling efisien yang dikenal manusia. Dengan konsumsi daya sekitar 20 watt, otak mampu menjalankan fungsi yang sangat kompleks mulai dari bahasa, emosi, kreativitas, hingga kesadaran.

Sebaliknya, Large Language Model modern membutuhkan infrastruktur industri dengan konsumsi energi yang sangat besar untuk mencapai kemampuan tertentu dalam pemrosesan bahasa dan pengenalan pola.

Perbedaan ini menunjukkan bahwa kecerdasan biologis dan kecerdasan buatan masih berada pada paradigma yang sangat berbeda.

Kemajuan AI memang luar biasa, namun efisiensi energi otak manusia tetap menjadi standar yang hingga kini belum mampu disamai teknologi modern. Di masa depan, arah perkembangan AI kemungkinan akan semakin mengarah pada upaya meniru efisiensi biologis melalui neuromorphic computing, photonic computing, dan berbagai pendekatan komputasi generasi baru.

Pada akhirnya, kajian mengenai energi dan kecerdasan tidak hanya menjadi isu teknologi, tetapi juga menyangkut keberlanjutan global, infrastruktur energi, dan masa depan hubungan antara manusia dengan mesin cerdas